『AI』を使っている人、という括りにおいても

・ガンガン思い通りに使っている

・使い方がイマイチよくわからない

とこの間には、さまざまにグラデーションがあるかと思います。

また使っていない人においても、

・AIの言うことに指示されたくない

・使いたいけどイマイチわからない

と、敬遠している人の間にもグラデーションがあります。

ここでは、AIをそこそこ使っていると思っている人でも

実はうまくいかず挫折するケースを考えてみたいと思います。

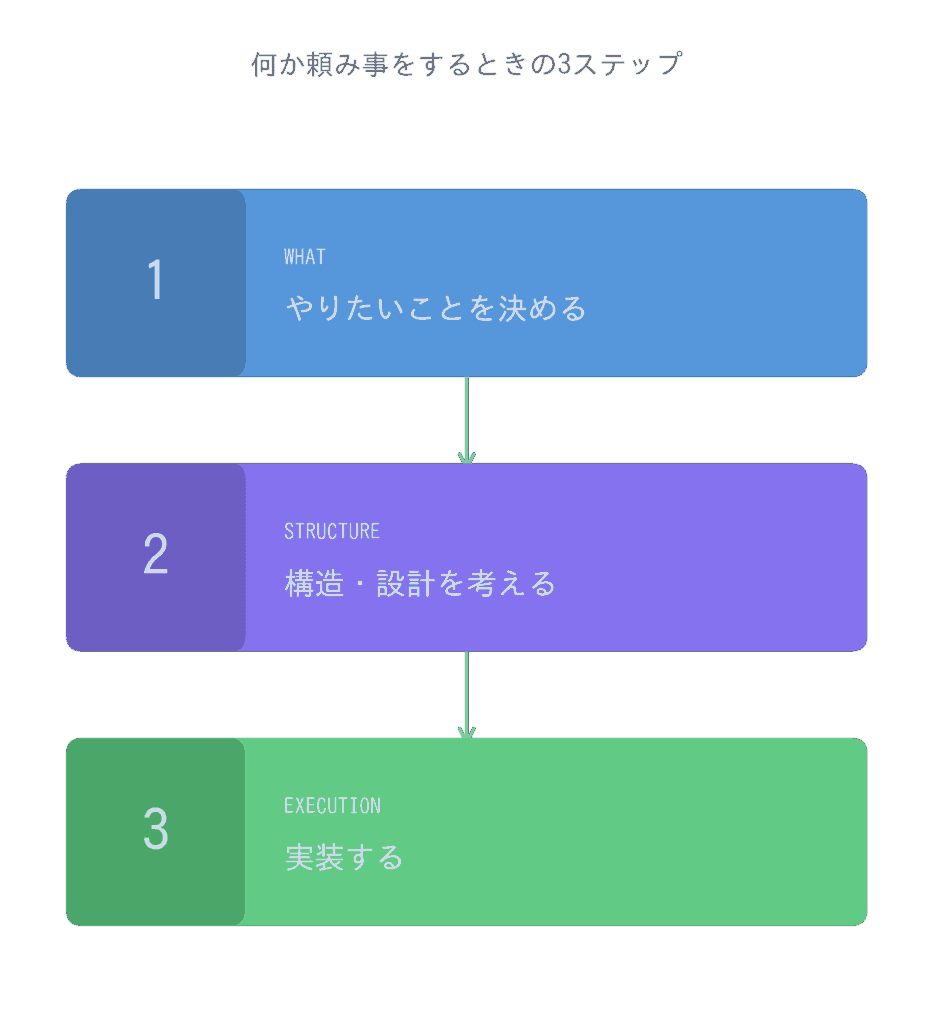

仕事するとき、頼み事をするときの「3ステップ」

これ、けんすうさんのnote記事で、激しく首を縦に振った話になります。

常々、ここが大方の人にとって一番の躓きどころだろうな

と思っていたことをうまく文章化してくれました。

私なりにもっとも響いた点を要約し、図にしてみました。

この図は、エンジニアが仕事する、あるいは人に技術的な頼み事をする際、

実際の手順を3つのステップで説明したものです。

実装する、という表現がエンジニアぽいですが、一般の生活においては

「行動する」「アウトプットを出す」「動いてみる」

程度にご理解いただければ万事に通じるかと思います。

その前に、STRUCTUREというステップがあってここが最重要ポイント。

一見ややこしいですが、一例をけんすうさんのコメントを引用するとこうなります。

けんすうさんのnoteより引用

- What(やりたいこと):「カフェの損益を知りたい」などのやりたいことがある

- Structure(中間構造・設計):何を変数にして、どう関係づけて、どう分解するか、

などのExcelなどの設計を考える- Execution(実装):数式やコードを書く、ファイルを整える

で、これ

AIに何かを打ち込んでアウトプットを出してもらう、

という流れに置き換えて考えてみても同じことが言えるのです、

何かをやりたい、というWHAT部分を考える、思いつくのは誰もができることです。

最後のEXECUTION(実装する)部分は、AIの最も得意とするところです。

ですが、今やここはなかなか差別化が難しい領域です。

ClaudeにしてもGeminiにしても、ChatGPTにしてもどれもこれもが

切磋琢磨して競争相手より抜きん出ようとしていますね。

ChatGPT 5.5 になって、 Image 2 が使えるから凄いとか騒いだところで

翌日には他の生成AIが新しい機能でカバーするとかの繰り返しであって、

AIの進化を私たちが騒いだところでどうにもなりません。

正直言うと、だから騒ぐのは無意味。

常に競い合っていてどんどんコモディティ化も進んで、

そこにある差異に執着しても無意味です。

では、何が重要なのか?

というと真ん中にあるSTRUCTURE部分なのです。

「問題のほぐしかた」で決まる

STRUCTUREとは、あるお題に対してその

問題のほぐしかた

に尽きます。

そこを補完してくれるのがManusなどのAIエージェントですけど、

それでももちろん完璧とはとても言い難い。

ChatGPTも単なる生成AIから、どんどんAIエージェント化しつつある

ようにも思えてそこにも差がなくなりつつありますが、

しっかりほぐしてくれるわけでは決してない。

要するに、お題に対して

これはいったいどういう問題なのか?

を具体的・論理的に分解するのが「ほぐす」という意味です。

できればMECE(ミーシー:もれなくだぶりもなく)、整然と分解するのが理想ですが

どういう方針(方向付け)で、どのように整理したいのかを意識すると

それなりに形になってくるものです。

AIがうまく使えない人は、ここが苦手です。

ここはエンジニアなら一般的に得意ではないにしても、

仕事として日常求められる部分でもあるので

苦労しつつも職業的に鍛えられているのが普通です。

AIで行き詰まる多くの人は、このSTRUCTURE部分抜きで

AIに指示することが多いはずです。

問題をほぐさないまま、結果だけ求める感じです。

シンプルな例でですが、こんなふうに問いかけることです。

- 「提案書を書いて!」

提案の骨子(STRUCTURE)が無いために、相手に刺さらないぼやけた話になる。 - 「おいしい店を紹介して!」

エリアやカテゴリー、ランチかディナーか(STRUCTURE)が無いために、全方位的な答えになる。 - 「この履歴で採用するかどうか教えて!」

採用基準(STRUCTURE)が不明なために、一般論としての答えとなり的外れ。

これだと欲しい答えにはほど遠いですね。

な~んだ、AIって結局この程度か?

となって終わってしまうのです。

またこのSTRUCTUREなしで漫然とした問いかけでも、

「壁打ち」で徐々に知りたいことに近づいていくことが多々あります。

ただし、これはAIを使っているのではなく、AIに使われている状況です。

AIは言われたことに答えているだけ(推論しているだけ)ですが、

実態はAIに誘導されているのに気づいていないのです。

繰り返しますが、特定AIの個々の機能で一喜一憂するのは無意味で時間の無駄です。

どんぐりの背比べ的なものなので、むしろ自分にしっくりくる生成AIをとりあえず

選んで使いつつ、他のAIがいい感じになったら切り替えてみたらどう?

というレベルでお考えになるのが無難です。

因みに私がこの記事投稿時点では、個人的にはChatGPTが盛り返してきて

結構使っていて、Manusも時々使うがGeminiはあまり使っていません。

Geminiに特定のURL(Webページ)指定してもどうも勘違いが多くなっていて

どこが原因がわからないため少し敬遠中。

ですがこれもきっとまた変わるでしょう。

ところで2026年5月3日の朝日新聞ニュースによると、

最高裁長官が「生成AIは『猛獣』と表現」

という見出しの記事がありました。

最高裁も証拠の整理などで活用を検討する生成AIについては「猛獣」と表現。

朝日新聞ニュース(2026.5.3)

今崎長官は、もっともらしく見えるが誤った回答をするハルシネーション(幻覚)や、

プライバシー侵害のリスクなどに触れ、

「うまく使いこなす力量が求められる。スキルを磨く必要があるだろう」と述べた。

まぁ、その通りだと思います。

最高裁はAIの使いこなしの話をしていますが、何をどう問うのかという

問題のほぐしかた(STRUCTURE)に通じるのも

その重要なスキルになると考えます。

以下の「人機共創プロジェクト HACC」でも最重要視しているのは、

結局は「問題のほぐしかた」にほかなりません。

-

-

人機共創プロジェクト HACC

AIを使うからAIと共創するへ。自分の強みを再発見し、商品化・収益化へつなげるHACC実践プログラム。

www.ifrv.net